M5 MacBook Airを買うとき、16GBか32GBかで約6万円の差をどう見るか——正直めちゃくちゃ悩みました。

決め手のひとつになったのが「ローカルLLMを手元で動かしてみたい」という気持ちで、実際に32GBを選んでLM Studioを試してみた結果、あの判断は正解だったと思っています。

この記事では、LM Studioでの実際の動作感・8Bと32Bの体感の差・16GBとの決定的な違いを正直にまとめます。

「どうせ買うなら!」って気持ちで32GBにしたんですが、これが大正解でした。

▼ そもそもM5 MacBook Airについて気になる方はこちら

- M5 MacBook Air 32GBでQwen3 8B・32Bがどれくらい快適に動くか

- 16GBとの実用上の違い(スワップの話も含めて正直に)

- LM Studioのセットアップにかかる時間と手順

- ローカルLLMを使うなら32GBが必要かどうかの結論

実際に試した環境

今回試したのはこちらの構成です!

| マシン | M5 MacBook Air 13インチ / ユニファイドメモリ 32GB |

| CPU | 10コア(高性能4 + 高効率6) |

| GPU | 10コア |

| Neural Engine | 16コア |

| メモリ帯域幅 | 153GB/s(M4比 +28%) |

| LM Studio | バージョン 0.4.8 |

| 試したモデル | Qwen3 8B(MLX)/ Qwen3 32B(MLX) |

今回実際に使ってみて一番効いたと感じたスペックは、メモリ帯域幅の153GB/sです。LLMの推論はモデルデータをメモリから高速に読み出す処理の連続なので、帯域幅が広いほどトークンの生成が速くなります。M4比で約28%向上しているこの数字は、スペック表の中でローカルLLMに一番直結する部分ですよ!

LM Studioとは

LM Studioは、ローカル環境でAIモデルを動かすためのGUIアプリです。完全無料で使えて、ChatGPTのようなチャット画面を自分のMac上に再現できます。入力した内容が外部サーバーに一切送られないのでプライバシーが守られるのが最大のメリット。インターネット接続も不要で、コマンドライン操作も一切不要です。モデルを選んでダウンロードボタンを押すだけで準備完了なので、「難しそう…」と思っている方も思ったより全然敷居は低いですよ!

動かすモデルは色々ありますが、今回はLlamaと並んで2026年現在注目を集めているQwen3を試しました。Alibaba製のオープンソースモデルで、119言語に対応しており日本語性能も高いのが特徴です。LM Studioの検索画面で「Qwen3」と入れるとすぐ見つかりますよ!

公式サイトからすぐダウンロードできます。セットアップも数分で終わりますよ!

LM Studioのセットアップ、実際どのくらいかかる?

「セットアップが大変そう」という声をよく聞くので、実際の流れをざっくり書いておきます。

lmstudio.aiからアプリをダウンロードしてインストール、これは1〜2分で終わります。アプリを開くと検索画面が出てくるので、使いたいモデル名(例:「Qwen3」)を検索して、一覧から好みのサイズを選んでダウンロードボタンを押すだけ。Qwen3 8BのMLXモデルなら約4.6GBなので、Wi-Fi環境で数分ほどでダウンロード完了します。

あとはチャット画面を開いてモデルを選択すれば、もう使えます。本当にそれだけです。APIキーも不要、アカウント登録も不要。「難しそう」と思っていた方ほど、拍子抜けするくらい簡単ですよ!

32Bモデルはファイルサイズが大きいので、ダウンロードだけ先に仕込んでおくのがおすすめです(笑)

Qwen3 8Bの結果

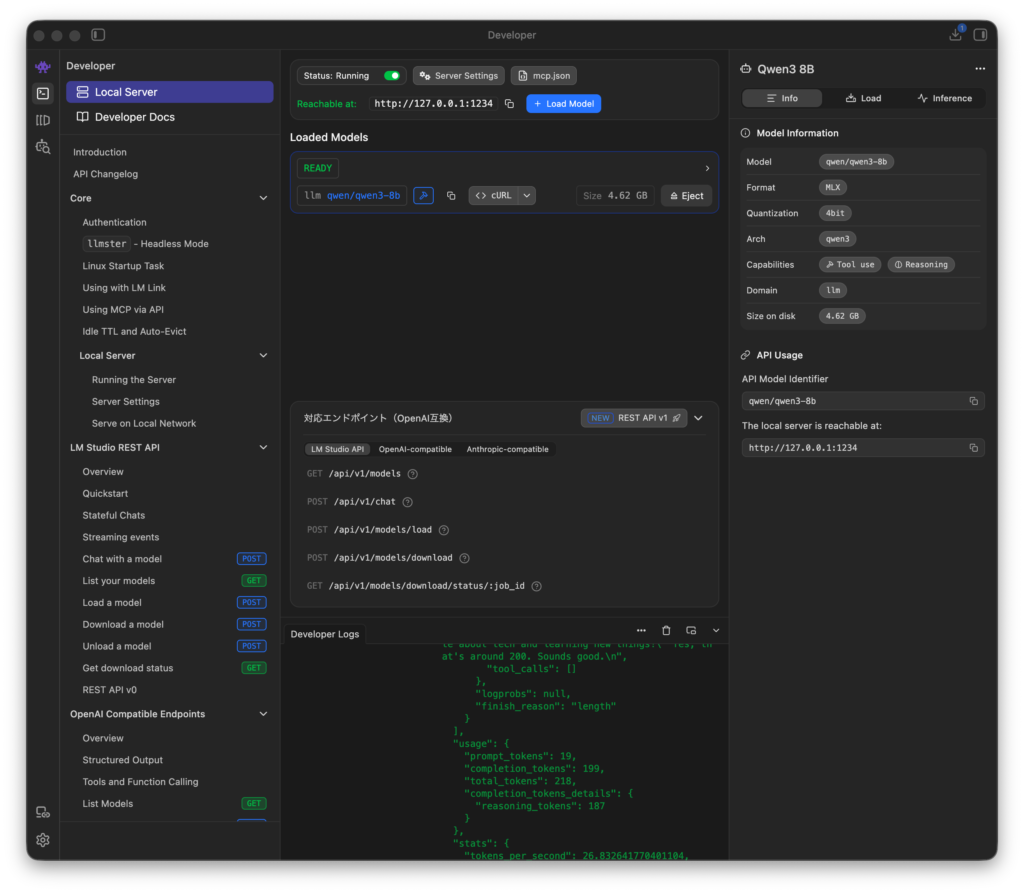

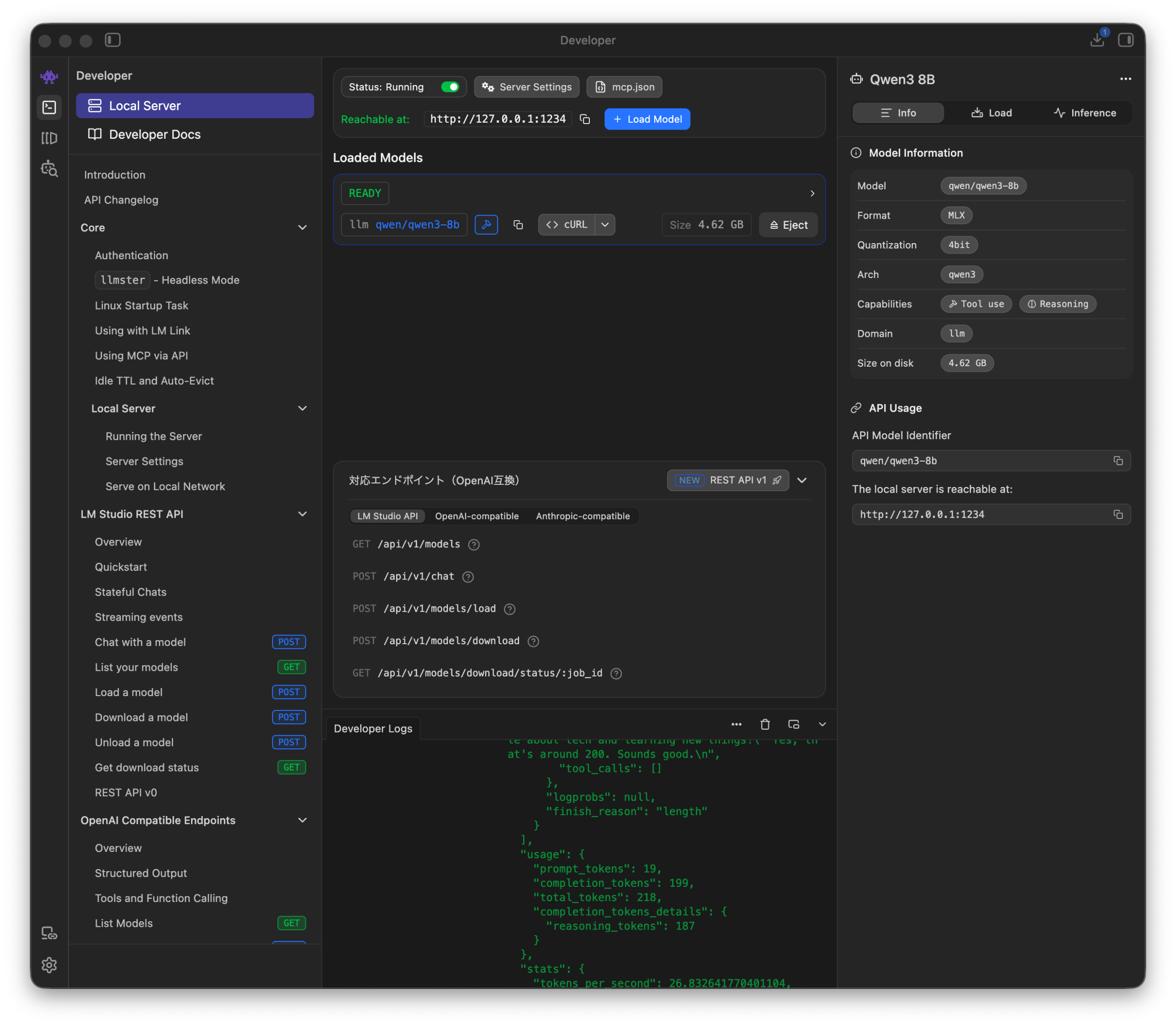

こんな感じでローカルサーバーを有効にして計測しました。

Qwen3 8B|余裕すぎるくらい快適に動く

8Bモデルは、32GBあれば本当に余裕で動きます。

| RAM使用量 | 5.74GB |

| 応答速度(トークン/秒) | 平均 27.13 tokens/s |

| ブログ下書き生成(500字) | 平均 18.6秒 |

実用テストとして試したのは主に3つです。①ブログ記事の下書き生成、②箇条書きからの文章化、③長文の要約。27tokens/s出ていれば会話していてストレスを感じるレベルではなく、体感としては「思ったよりずっと使える」という印象でした。

Qwen3 8BのMLXモデルはファイルサイズが約4.6GB。32GBのユニファイドメモリの中ではかなり小さい部類で、モデルを読み込んでいても他のアプリと普通に共存できます。Safariを数タブ開きながら、NotionでメモしつつAIと会話する、という使い方も全然問題なかったですよ。

ちなみに8Bで特に活躍するのがプライバシーが気になる用途です。会社の企画書のたたき台作成や、他人に見せたくないアイデアの壁打ち。クラウドのAIだと「これ、どこかに送られてるんだよな…」と気になることがありますが、ローカルなら完全に手元だけで完結します。地味に大きいポイントですよ!

「手元でAIが動いてる」という体感はクラウドとはまた違う面白さがあって、地味にテンション上がりますよねぇ。まず8Bから試してみるのがおすすめです!

Qwen3 32Bの結果

Qwen3 32B|32GBをフルに使って動く、正直な話

32Bモデルは、32GBあってこそ挑戦できる領域です。ただし、ここは正直に書きます。

| RAM使用量 | 17.66GB |

| 応答速度(トークン/秒) | 平均 6.65 tokens/s |

| ブログ下書き生成(500字) | 平均 82.9秒 |

| 実用感 | 出力クオリティは高いが、待ち時間は覚悟が必要 |

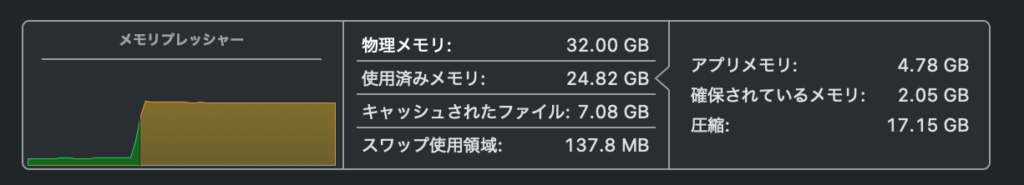

Qwen3 32BのMLXモデルは18.45GB。スワップ自体はほぼ発生しない(計測時137MB程度)ものの、macOSがメモリを大量に圧縮しながら動かす状態になります。アクティビティモニタではメモリプレッシャーが黄色になっていて、「余裕で動く」というより「32GBをフルに使いきって動く」という表現が正確です。他のアプリは閉じて専用で使うのがおすすめです。

ただ、8Bと32Bの出力クオリティの差は明確にありました。簡単な質問への回答なら8Bで十分ですが、「論理的に筋の通った長文を書いてほしい」「複雑な条件を整理してほしい」という用途では32Bの精度は一段上です。ブログのリード文や商品説明の原稿を書かせると、8Bとの差がはっきりわかりますよ。

ここで16GBモデルとの決定的な差が出てきます。Qwen3 32Bは18.45GBあるので、16GBでは大半をSSDにスワップしながら動かすことになり、応答速度が実用に耐えないレベルに落ちます。32GBだからこそスワップをほぼ発生させずに動かせる。6.65 tokens/sという速度は速くはないですが、クオリティの高い出力を手元で得られるという体験は、32GBを選んだ価値を感じる瞬間のひとつでした。

1分以上待って返ってくる答えのクオリティが8Bと明らかに違う、という体験はなかなか面白いですよ。「遅いけど賢い」を手元で試せるのが32GBの面白さだと思います!

32GBを選ぶべき理由(正直な評価)

ここは正直に書いておきます!

32GBが必要ない人もいます。ブラウジング・動画視聴・ブログ執筆がメインなら、16GBで困ることはほぼないです。価格差の6万円を別のことに使うのも全然アリだと思いますよ。

一方でローカルLLMを使う観点で見ると、16GBと32GBの差は単純な「余裕の差」ではなくなります。

| 比較項目 | 16GB | 32GB |

| Qwen3 8B(MLX) | △ 他アプリとの共存は厳しめ | ◎ 余裕で動作(5.74GB使用) |

| Qwen3 32B(MLX) | ✕ スワップ大量発生・実用不可 | △ メモリをフルに使うが動作する |

| 複数アプリ同時起動 | △ スワップが発生しやすい | ◎ 快適 |

| 将来のモデル対応 | △ 選択肢が限られる | ◎ 余裕がある |

日常作業での16GBと32GBの体感差については前回のレビュー記事で詳しく書いていますが、普段使いのストレスが32GBでほぼゼロになったのは確かです。そこにローカルLLMという用途が加わると、その差はさらに大きくなります。

それに、ローカルAIはモデルの軽量化が進んでいて今後もどんどん新しいモデルが出てきます。いま32GBを選んでおくことが、数年後の選択肢を守ることにもなるんですよ。Appleシリコンのメモリは後から増設できないので、「あとで後悔したくない」という方はここで奮発しておくのがおすすめです!

6万円の差を「高い」と見るか「保険料」と見るか、ですよねぇ。僕は払ってよかったと思っています!

▼ M5 MacBook Air の価格をチェックする

メモリ24GBモデルです!メモリ32GBはApple公式へ!!

こんな人におすすめ!

「自分に合ってるかな?」と思っている方、こんな人にはぴったりだと思いますよ!

- ローカルLLMを快適に使いたい(8Bはもちろん、32Bもちゃんと動かしてみたい)

- 仕事の文章作成や壁打ちにAIを活用したいけど、クラウドに送りたくない

- ブログ・ライター・クリエイター系の作業がメインで、AIを道具として使いたい

- M1〜M3世代からの乗り換えを考えている人

- 長く使い倒す前提でスペックを選びたい人

逆に、大きなローカルAIモデルを本格的に回したい・AI開発が主目的という方には、Airより上の構成や別の機種を考えたほうが現実的だと思います。M5 MacBook Airは本格的なAI開発機というより、「ローカルLLMって面白い」と気づかせてくれるマシンです。まずここから入ってみるのが一番ですよ!

クラウドに送らずプライバシーを守りながらAIが動く、この安心感はクラウドとはまた別の価値ですよ。32GBを選んでよかったと思えるユースケースが、これからどんどん増えそうで楽しみです!

まとめ

M5 MacBook Air 32GBは、ローカルLLMの快適動作という意味では現時点でかなりコスパの良い選択肢だと思います!

Qwen3 8Bは27tokens/sで快適に動いて、32Bもスワップをほぼ発生させずにMacBook Air上で動く。セットアップも思ったより簡単で、プライバシーを守りながらAIを手元で使うという体験はクラウドとはまた違う面白さがありますよ。

スペック選びで迷っているなら、一度「ローカルLLMを触ってみたい自分」を想像してみてください。その可能性がちょっとでもあるなら、32GBにしといて正解だと思いますよ!

「買ってよかった!」と毎日感じてます。気になっている方はぜひチェックしてみてください!

▼ 実機レビューも読んでみてください!

▼ M5 MacBook Air の価格をチェックする

メモリ24GBモデルです!メモリ32GBはApple公式へ!!

※ 本記事の数値は実際に計測した値です。モデルやLM Studioのバージョンアップにより変動する場合があります。

コメント